- Acta Optica Sinica

- Vol. 42, Issue 23, 2315001 (2022)

Abstract

Keywords

Key Laboratory of Photoelectronic Imaging Technology and System, Ministry of Education, School of Optics and Photonics, Beijing Institute of Technology, Beijing 100081, China

1 引言

虹膜识别具有唯一性、稳定性和非接触性等优势,已在金融、海关和公安等重要的身份认证场景中得到广泛应用[

传统虹膜防伪检测方法基于虹膜的光学特性或纹理特征进行检测。He等[

随着深度学习在生物特征识别领域中的发展,研究人员陆续提出了一些能自适应提取深度特征的虹膜防伪检测网络。Raghavendra等[

鉴于上述背景,本文提出了一种基于循环注意力卷积神经网络(RACNN)[

2 RAINet网络设计

2.1 设计思路

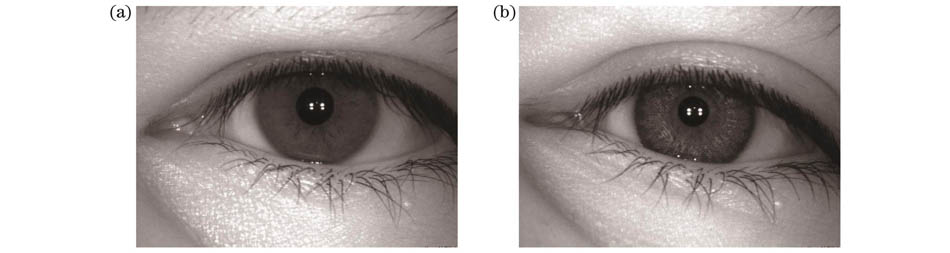

虹膜传感器采集到的同一人的真实虹膜图像和纹理隐形眼镜虹膜图像,如

![]()

Figure 1.Real iris and textured contact lens iris. (a) Real iris; (b) textured contact lens iris

为了有效地针对关键区域的特征差异进行防伪检测,将纹理隐形眼镜虹膜防伪检测看作细粒度图像分类进行处理。真实虹膜与纹理隐形眼镜伪造虹膜的相似度极高,且图像中大部分区域被相近的巩膜、眼睑和睫毛等背景特征占据[

2.2 网络框架

RAINet的网络框架如

![]()

Figure 2.RAINet iris anti-spoofing detection network framework

2.3 实现原理

RAINet中包含三级特征分类网络:全局特征分类网络G-FCN、虹膜特征分类网络I-FCN和纹理特征分类网络T-FCN,均采用了MobileNetV2的特征层结构,但各自拥有独立的参数。MobileNetV2使用深度可分离卷积进行特征提取,将计算复杂度减少为使用标准卷积的

| Network | Params /MB | FLOPs / |

|---|---|---|

| VGG16 | 134.28 | 61.75 |

| MobileNetV2 | 2.22 | 1.28 |

Table 1. Comparison of MobileNetV2 and VGG16

MobileNetV2的特征层由Conv2d和Bottleneck组成,具体结构参数如

| Input | Operator | Factor | Output | Frequency | Step |

|---|---|---|---|---|---|

| 224×224×3 | Conv2d | 32 | 1 | 2 | |

| 112×112×32 | Bottleneck | 1 | 16 | 1 | 1 |

| 112×112×16 | Bottleneck | 6 | 24 | 2 | 2 |

| 56×56×24 | Bottleneck | 6 | 32 | 3 | 2 |

| 28×28×32 | Bottleneck | 6 | 64 | 4 | 2 |

| 14×14×64 | Bottleneck | 6 | 96 | 3 | 1 |

| 14×14×96 | Bottleneck | 6 | 160 | 1 | 1 |

| 7×7×160 | Bottleneck | 6 | 320 | 1 | 1 |

Table 2. Structural parameters of MobileNetV2 feature layer

Bottleneck的工作原理如

![]()

Figure 3.Inverse residual block of Bottleneck

RAINet中引入了RACNN的循环注意力机制[

虹膜是一个近似同心圆的圆环状结构,理想情况下定位到的虹膜区域和纹理区域应该是正方形,长宽比约为1∶1。如

![]()

Figure 4.Location parameters of feature region. (a) Location parameters of iris region; (b) location parameters of texture region;(c) texture region after interpolation

以虹膜注意力网络I-APN为例,将虹膜图像的左上角设为坐标系的原点,其

根据虹膜区域的顶点坐标,使用图像掩模函数

常规的图像裁剪方法是根据区域坐标生成一个二值图像掩模,该方法虽然操作简单且计算量小,但掩模函数

式中:

![]()

Figure 5.Image masks of feature region. (a) Image masks of iris region; (b) image masks of texture region

RAINet使用两个不同的损失函数进行优化:对特征分类网络使用分类损失函数;对注意力网络使用排序损失函数[

式中:

分类损失使用交叉熵损失函数进行计算,

使用交叉熵损失函数可以避免网络出现梯度弥散问题,使特征分类网络的预测结果有效地向真实标签收敛。

排序损失通过相邻两级特征分类网络对真实标签的预测误差进行计算,

式中:

RAINet的训练目的是让特征分类网络和注意力网络相互促进,训练过程为:固定两个注意力网络的各层参数,训练三级特征分类网络直至收敛;固定三级特征分类网络的各层参数,训练两个注意力网络直至收敛。在每个训练轮次中迭代交替进行直至两种网络的损失都收敛。

3 实验结果与分析

实验的硬件设备为:中央处理器(CPU)型号为Intel Xeon Silver 4110,图形处理单元(GPU)型号为NVIDA Quadro GV100,内存为 32GB。软件环境为:Centos7操作系统、Python3.6开发环境和Pytorch1.4深度学习框架。

3.1 实验数据集

实验选用包含真实虹膜样本和隐形眼镜虹膜样本的两个公开数据库IIITD CLI[

IIITD CLI数据库由印度理工学院德里分校提供,包含来自101位实验者的6570张样本图像,图像分辨率为640 pixel×480 pixel。

![]()

Figure 6.Sample images from IIITD CLI database. (a) Real iris from Cogent; (b) textured contact lens iris from Cogent; (c) real iris from Vista; (d) texture contact lens iris from Vista

ND系列数据库来自美国圣母大学的计算机视觉实验室,该系列中有三个不同时期的图像数据库ND Contact、NDCLD15和NDSPI19(NDSPI19是从NDCLD15中筛选出来的),共计18196张样本图像,图像分辨率为640 pixel×480 pixel。

![]()

Figure 7.Sample images from ND series databases. (a) Real iris from NDC LG4000; (b) textured contact lens iris from NDC LG4000; (c) real iris from NDC AD100; (d) textured contact lens iris from NDC AD100; (e) real iris from NDCLD15; (f) textured contact lens iris from NDCLD15

为了对数据样本进行批量化的训练和测试,先将各个数据集的样本图像归一化为448 pixel×448 pixel,再按照7∶3的比例将数据集随机划分为训练集和测试集。

3.2 训练参数与评价指标

在训练阶段中,先加载经过ImageNet预训练的MobileNetV2对三级特征分类网络进行初始化,再采用带动量的批量随机梯度下降算法(BSGD)更新网络参数,由一个批次的数据样本共同决定梯度的更新方向,既能降低梯度下降的随机性,又能降低梯度更新的时间成本。引入动量可以使参数更新方向与此前积累的更新方向关联,进而达到加速收敛和缓解震荡的目的。在网络训练过程中,将学习率的初始值设为0.001,动量因子设为0.9,权重衰减设为0.0005,批尺寸设为32,迭代次数设为50。

测试阶段使用正确分类率(CCR)和受试者工作特性曲线(ROC)作为衡量检测精度的评价指标[

式中:

ROC曲线是以真正率(TPR)为纵坐标,假正率(FPR)为横坐标绘制而成的曲线,是反映网络灵敏性和特异性连续变化的综合性指标。ROC曲线的线下面积(AUC)越大,说明网络的分类效果越好。TPR和FPR的计算公式为

Params为网络所有参数层的权重参数量,主要包括卷积层、批归一化层和全连接层等,可用于衡量网络的空间复杂度,网络整体的Params越小,说明网络参数量越少,内存占用越小。FLOPs是指浮点运算数,可用于衡量网络的时间复杂度,FLOPs越小,说明网络的计算量越小,计算速度越快消耗越小。

3.3 实验结果

在同传感器、跨传感器和跨数据库三种不同实验条件下进行多组实验,评估RAINet的检测精度与运算成本,并将其与循环注意力卷积神经网络RACNN[

3.3.1 消融实验

RAINet与RACNN使用相同的循环网络结构,但对网络融合策略进行了改进,为验证RAINet的循环网络结构和输出策略改进所产生的效果,对虹膜注意力网络I-APN、纹理注意力网络T-APN和网络融合策略进行消融实验。实验结果如

| Database | Network | |||

|---|---|---|---|---|

Cogent (intra-sensor) | G-FCN | 100.00 | 99.15 | 99.57 |

| I-FCN | 100.00 | 99.43 | 99.71 | |

| T-FCN | 100.00 | 99.70 | 99.85 | |

| RAINet3 | 100.00 | 99.43 | 99.71 | |

| RAINet | 100.00 | 99.70 | 99.85 | |

Cogent/Vista (inter-sensor) | G-FCN | 100.00 | 98.03 | 99.02 |

| I-FCN | 100.00 | 100.00 | 100.00 | |

| T-FCN | 100.00 | 99.48 | 99.74 | |

| RAINet3 | 100.00 | 99.34 | 99.67 | |

| RAINet | 100.00 | 99.68 | 99.84 | |

Cogent/NDC LG4000 (inter-database) | G-FCN | 91.25 | 100.00 | 95.62 |

| I-FCN | 96.22 | 100.00 | 98.11 | |

| T-FCN | 96.45 | 100.00 | 98.22 | |

| RAINet3 | 94.56 | 100.00 | 97.27 | |

| RAINet | 96.93 | 100.00 | 98.46 |

Table 3. Results of ablation experiments

消融实验的结果表明:使用全局特征分类网络G-FCN对原始虹膜图像直接进行分类,检测精度并不理想;使用结构相同的虹膜特征分类网络I-FCN对虹膜注意力网络I-APN定位到的虹膜区域图像进行分类,检测精度有明显的提升;进一步使用结构相同的纹理特征分类网络T-FCN对纹理注意力网络T-APN定位到的纹理区域图像进行分类,在同传感器和跨数据库条件下的检测精度略有提升。融合多层级特征进行分类可以充分利用图像的特征信息,但因G-FCN的分类效果不佳而影响了RAINet3的检测精度。在舍弃了G-FCN的预测结果后,RAINet的准确率相较于RAINet3有所提升,说明在虹膜防伪检测任务中减少背景特征的干扰,也有利于提升检测精度。

3.3.2 对比实验

1)同传感器检测实验

用同一传感器采集的样本图像对网络进行训练与测试,训练样本和测试样本的光照亮度、采集角度等成像参数均保持一致。实验的数据集为Cogent、Vista、NDC LG4000和NDC AD100,得到的4组实验结果如

| Database | Network | |||

|---|---|---|---|---|

| Cogent | RACNN | 100.00 | 99.24 | 99.62 |

| GHCLNet | 100.00 | 89.86 | 94.98 | |

| DCLNet | 99.10 | 94.19 | 96.64 | |

| RAINet | 100.00 | 99.70 | 99.85 | |

| Vista | RACNN | 100.00 | 97.72 | 98.86 |

| GHCLNet | 100.00 | 94.60 | 97.30 | |

| DCLNet | 100.00 | 93.19 | 96.60 | |

| RAINet | 100.00 | 100.00 | 100.00 | |

| NDC LG4000 | RACNN | 100.00 | 99.21 | 99.60 |

| GHCLNet | 99.75 | 95.24 | 97.50 | |

| DCLNet | 99.93 | 92.86 | 96.40 | |

| RAINet | 100.00 | 99.78 | 99.89 | |

| NDC AD100 | RACNN | 100.00 | 99.52 | 99.76 |

| GHCLNet | 100.00 | 91.67 | 95.84 | |

| DCLNet | 98.50 | 89.49 | 94.00 | |

| RAINet | 100.00 | 100.00 | 100.00 |

Table 4. Comparison of CCR under intra-sensor detection unit: %

![]()

Figure 8.ROC curves under intra-sensor detection

2)跨传感器检测实验

用同一数据库中不同传感器采集的样本图像对网络进行训练与测试,训练样本和测试样本的光照亮度、采集角度等成像参数有所不同。实验将Cogent数据集和Vista数据集成对使用,将NDC LG4000数据集和NDC AD100数据集成对使用,得到的4组实验结果如

| Database | Network | |||

|---|---|---|---|---|

| Cogent/Vista | RACNN | 100.00 | 99.68 | 99.84 |

| GHCLNet | 99.25 | 93.40 | 96.33 | |

| DCLNet | 99.83 | 89.55 | 94.69 | |

| RAINet | 100.00 | 99.68 | 99.84 | |

| Vista/Cogent | RACNN | 90.21 | 96.17 | 93.19 |

| GHCLNet | 85.36 | 96.74 | 91.05 | |

| DCLNet | 99.82 | 81.43 | 90.63 | |

| RAINet | 94.54 | 97.48 | 96.03 | |

| NDC LG4000/AD100 | RACNN | 100.00 | 97.33 | 98.66 |

| GHCLNet | 98.00 | 91.90 | 94.95 | |

| DCLNet | 100.00 | 92.00 | 96.00 | |

| RAINet | 100.00 | 100.00 | 100.00 | |

| NDC AD100/LG4000 | RACNN | 100.00 | 84.18 | 92.09 |

| GHCLNet | 100.00 | 81.25 | 90.63 | |

| DCLNet | 97.92 | 83.00 | 90.46 | |

| RAINet | 100.00 | 86.76 | 93.36 |

Table 5. Comparison of CCR under inter-sensor detection

![]()

Figure 9.ROC curves under inter-sensor detection

3)跨数据库检测实验

用不同数据库中不同传感器采集的样本图像对网络进行训练与测试,训练样本和测试样本在成像参数上有所不同,且样本源的人种分布、眼镜品牌也有差别。实验将Cogent数据集和ND系列的三个数据库集两两配对,得到的6组实验结果如

| Database | Network | |||

|---|---|---|---|---|

| Cogent/NDC LG4000 | RACNN | 93.12 | 100.00 | 96.56 |

| GHCLNet | 90.07 | 100.00 | 95.02 | |

| DCLNet | 87.94 | 100.00 | 93.95 | |

| RAINet | 96.93 | 100.00 | 98.46 | |

| Cogent/ND 15 | RACNN | 100.00 | 88.80 | 94.40 |

| GHCLNet | 90.07 | 100.00 | 95.02 | |

| DCLNet | 100.00 | 81.40 | 90.70 | |

| RAINet | 100.00 | 92.20 | 96.10 | |

| Cogent/ND 19 | RACNN | 92.70 | 99.80 | 96.15 |

| GHCLNet | 90.17 | 99.76 | 93.46 | |

| DCLNet | 88.68 | 100.00 | 92.57 | |

| RAINet | 93.90 | 100.00 | 96.95 | |

| NDC LG4000/ND 15 | RACNN | 98.00 | 98.80 | 98.40 |

| GHCLNet | 99.60 | 95.60 | 97.60 | |

| DCLNet | 98.80 | 99.40 | 99.10 | |

| RAINet | 99.40 | 99.20 | 99.30 | |

| NDC LG4000/ND 19 | RACNNt | 100.00 | 99.52 | 99.77 |

| GHCLNet | 100.00 | 94.05 | 97.96 | |

| DCLNet | 100.00 | 89.76 | 96.49 | |

| RAINet | 100.00 | 99.76 | 99.91 | |

| ND 15/ND 19 | RACNN | 92.82 | 100.00 | 96.43 |

| GHCLNet | 93.03 | 100.00 | 95.42 | |

| DCLNet | 92.41 | 100.00 | 95.02 | |

| RAINet | 92.91 | 100.00 | 96.45 |

Table 6. Comparison of CCR under inter-database detection

![]()

Figure 10.ROC curves under inter-database detection

4)检测成本实验

对比RAINet与RACNN和其他防伪检测网络的运算成本,实验结果如

| Network | Params /MB | FLOPs / |

|---|---|---|

| RACNN | 373.34 | 92.65 |

| GHCLNet | 23.51 | 4.12 |

| DCLNet | 6.96 | 2.88 |

| RAINet | 86.96 | 1.87 |

Table 7. Comparison of calculated costs for each network

对比实验的结果表明:相比于其他防伪检测网络,RAINet能够有效提取出真实虹膜与纹理隐形眼镜之间微小的特征差异并进行精确检测;即使在训练样本不足或跨数据库检测等特殊条件下,RAINet仍有较好的表现,证明了RAINet的有效性和泛化性;虽然RAINet的Params高于GHCLNet和DCLNet,但FLOPs低于GHCLNet和DCLNet,而计算量是决定运算成本的主要因素;相比于RACNN,改进后的RAINet更适用于虹膜防伪检测任务,显著降低运算成本的同时,还能保持良好的检测精度。因此,综合考虑网络的检测精度和运算成本,RAINet具有更优的综合性能。

4 结论

为有效对真实虹膜与纹理隐形眼镜虹膜之间微小的特征差异进行防伪检测,将纹理隐形眼镜虹膜防伪检测问题视为细粒度图像分类问题进行处理,提出了一种循环注意力隐形眼镜虹膜防伪检测方法RAINet。首先,RAINet引入循环注意力机制先后对原始虹膜图像的虹膜区域和纹理区域进行无监督定位,使网络能模拟人眼的视觉特性,进而不断聚焦于关键区域的特征差异以进行防伪检测。其次,RAINet采用MobileNetV2对特征分类网络进行轻量化处理,解决了使用循环网络结构导致的运算成本过高的问题。此外,RAINet作为端到端网络无需图像预处理或人工标注,能够方便地集成到虹膜识别系统中。在IIITD CLI数据库和ND系列数据库上进行的实验表明:RAINet可以针对真伪虹膜之间关键区域的微小特征差异进行检测,相比于其他虹膜防伪检测网络具有更好的准确性和泛化性;RAINet控制了运算成本,相比于RACNN更符合在边缘计算设备上应用部署的条件。后续的研究可以对网络的损失函数进行进一步优化,以提升防伪检测精度。

References

[1] Li H Q, Sun Z N, Tan T N et al. Progress and trends in iris recognition[J]. Journal of Information Security Research, 2, 40-43(2016).

[2] Chen R, Lin X R, Ding T H. Liveness detection for iris recognition using multispectral images[J]. Pattern Recognition Letters, 33, 1513-1519(2012).

[3] Wu L F, Ma Y K, Zhou P et al. Review of biometric template protection[J]. Chinese Journal of Scientific Instrument, 37, 2407-2420(2016).

[4] Das P, Mcfiratht J, Fang Z Y et al. Iris liveness detection competition (LivDet-Iris) - the 2020 edition[C](2020).

[5] He Y Q, Hou Y S, Li Y J et al. Liveness iris detection method based on the eye's optical features[J]. Proceedings of SPIE, 7838, 236-243(2010).

[6] Lee J, Lee S H, Park J I. Detection of abnormal iris authentication[C](2019).

[7] Daugman J. Demodulation by complex-valued wavelets for stochastic pattern recognition[J]. International Journal of Wavelets, Multiresolution and Information Processing, 1, 1-17(2003).

[8] He Z F, Sun Z N, Tan T N et al. Efficient iris spoof detection via boosted local binary patterns[M]. Tistarelli M, Nixon M S. Advances in biometrics, 5558, 1080-1090(2009).

[9] Doyle J S, Bowyer K W. Robust detection of textured contact lenses in iris recognition using BSIF[J]. IEEE Access, 3, 1672-1683(2015).

[10] Lovish, Nigam A, Kumar B et al. Robust contact lens detection using local phase quantization and binary Gabor pattern[M]. Azzopardi G, Petkov N. Computer analysis of images and patterns, 9256, 702-714(2015).

[11] Agarwal R, Jalal A S, Arya K V. Local binary hexagonal extrema pattern (LBHXEP): a new feature descriptor for fake iris detection[J]. The Visual Computer, 37, 1357-1368(2021).

[12] Raghavendra R, Raja K B, Busch C. ContlensNet: robust iris contact lens detection using deep convolutional neural networks[C], 1160-1167(2017).

[13] Chen C J, Ross A. A multi-task convolutional neural network for joint iris detection and presentation attack detection[C], 44-51(2018).

[14] Gupta M, Singh V, Agarwal A et al. Generalized iris presentation attack detection algorithm under cross-database settings[C], 5318-5325(2021).

[15] Singh A, Mistry V, Yadav D et al. GHCLNet: a generalized hierarchically tuned contact lens detection network[C](2018).

[16] Choudhary M, Tiwari V, Venkanna U. An approach for iris contact lens detection and classification using ensemble of customized DenseNet and SVM[J]. Future Generation Computer Systems, 101, 1259-1270(2019).

[17] Yu F S, Yu J, Lu Y F et al. Gender classification of iris image based on residual network[J]. Laser & Optoelectronics Progress, 58, 1610022(2021).

[18] Agarwal R, Jalal A S. Presentation attack detection system for fake Iris: a review[J]. Multimedia Tools and Applications, 80, 15193-15214(2021).

[19] Fu J L, Zheng H L, Mei T. Look closer to see better: recurrent attention convolutional neural network for fine-grained image recognition[C], 4476-4484(2017).

[20] Sandler M, Howard A, Zhu M L et al. MobileNetV2: inverted residuals and linear bottlenecks[C], 4510-4520(2018).

[21] Yuan W Q, Bai Y, Ke L. Analysis of relationship between region of iris and the accuracy rate[J]. Acta Optica Sinica, 28, 937-942(2008).

[22] Zhang W X, Zhu Z C, Zhang Y H et al. Cell image segmentation method based on residual block and attention mechanism[J]. Acta Optica Sinica, 40, 1710001(2020).

[23] Kohli N, Yadav D, Vatsa M et al. Revisiting iris recognition with color cosmetic contact lenses[C](2013).

[24] Yadav D, Kohli N, Doyle J S et al. Unraveling the effect of textured contact lenses on iris recognition[J]. IEEE Transactions on Information Forensics and Security, 9, 851-862(2014).

[25] Doyle J S, Bowyer K W, Flynn P J. Variation in accuracy of textured contact lens detection based on sensor and lens pattern[C](2013).

[26] Czajka A, Fang Z Y, Bowyer K. Iris presentation attack detection based on photometric stereo features[C], 877-885(2019).

[27] Silva P, Luz E, Baeta R et al. An approach to iris contact lens detection based on deep image representations[C], 157-164(2015).

[28] You X A, Zhao P, Mu X D et al. Heterogeneous noise iris segmentation based on attention mechanism and dense multiscale features[J]. Laser & Optoelectronics Progress, 59, 0410006(2022).

Set citation alerts for the article

Please enter your email address